Kto tak naprawdę stoi za systemem binarnym? Poznaj niejednego ojca cyfrowej rewolucji

Kiedy mówimy o systemie binarnym, czyli dwójkowym, który stanowi fundament całej współczesnej informatyki, na myśl od razu przychodzi nazwisko Gottfrieda Wilhelma Leibniza. Ten wybitny niemiecki filozof i matematyk, żyjący na przełomie XVII i XVIII wieku, jest powszechnie uznawany za tego, który sformalizował i opisał nowoczesny system binarny. Jego prace otworzyły drzwi do świata, w którym wszystko, od tekstu po skomplikowane obliczenia, można przedstawić za pomocą zaledwie dwóch symboli: 0 i 1. Niemniej jednak, historia tej koncepcji jest znacznie bogatsza i sięga czasów znacznie wcześniejszych niż działalność Leibniza.

Gottfried Leibniz: człowiek, który nadał zerom i jedynkom współczesny sens

Gottfried Wilhelm Leibniz jest kluczową postacią w historii systemu binarnego, ponieważ to on stworzył kompletny i spójny system matematyczny oparty na dwóch cyfrach. Jego wkład polegał na systematycznym przedstawieniu zasad działania tego systemu, co pozwoliło na jego dalszy rozwój i zastosowanie. Leibniz nie tylko opisał, jak można reprezentować liczby za pomocą zera i jedynki, ale także pokazał, jak wykonywać na nich podstawowe operacje arytmetyczne. To właśnie jego formalne podejście sprawiło, że system binarny przestał być jedynie ciekawostką, a stał się solidną podstawą dla przyszłych odkryć.

Czy Leibniz był pierwszy? Starożytne korzenie kodu binarnego

Choć Leibniz jest ojcem nowoczesnego systemu binarnego, idea reprezentowania informacji za pomocą dwóch stanów nie narodziła się wraz z nim. Wzmianki o koncepcjach zbliżonych do systemu dwójkowego można odnaleźć już w starożytnym Egipcie, gdzie stosowano specyficzne metody podziału i mnożenia. W Indiach, uczony Pingala w starożytnych tekstach o metryce poetyckiej opisywał system, który można interpretować jako binarny, używając analogii między krótkimi i długimi sylabami. Również szkocki matematyk John Napier w XVI wieku, pracując nad logarytmami, używał pewnych elementów, które można powiązać z ideą dwójkową. Te fragmentaryczne idee, rozproszone w czasie i przestrzeni, czekały na kogoś, kto potrafi je zebrać i ułożyć w spójną całość.

Jak wyglądał świat przed systemem dwójkowym? Krótka historia liczenia

Zanim system binarny zyskał swoje współczesne znaczenie, ludzkość przez wieki rozwijała różne sposoby reprezentowania i przetwarzania liczb. Od prostych metod liczenia na palcach, przez użycie kamieni czy patyków, po złożone systemy liczbowe, które ewoluowały wraz z rozwojem cywilizacji. Te systemy, choć skuteczne w swoich czasach, miały swoje ograniczenia, szczególnie gdy zaczęto myśleć o automatyzacji i maszynach zdolnych do przetwarzania informacji.

Od palców po system dziesiętny: dlaczego potrzebowaliśmy czegoś więcej?

Nasza historia liczenia jest długa i fascynująca. Początkowo opieraliśmy się na tym, co mieliśmy pod ręką na własnych palcach. To naturalne przywiązanie do dziesięciu kończyn doprowadziło do powszechnego przyjęcia systemu dziesiętnego, który znamy dzisiaj. System ten, choć intuicyjny i wygodny do codziennych obliczeń, okazał się jednak mniej praktyczny, gdy pojawiła się potrzeba tworzenia maszyn, które mogłyby wykonywać skomplikowane operacje. System dziesiętny, z jego dziesięcioma różnymi stanami dla każdej cyfry, był trudniejszy do zaimplementowania w prostych, mechanicznych lub elektrycznych układach. Potrzebne było coś prostszego, coś, co można łatwo odróżnić i kontrolować.

Inspiracje z Dalekiego Wschodu: jak chińska Księga Przemian (I Ching) wpłynęła na Leibniza?

Gottfried Wilhelm Leibniz był człowiekiem o szerokich zainteresowaniach, a jego uwaga skierowana była również na kultury Wschodu. Szczególnie zafascynowała go starożytna chińska "Księga Przemian", znana jako I Ching. Leibniz dostrzegł w jej heksagramach, czyli sześcioliniowych symbolach składających się z ciągłych i przerywanych kresek, doskonałe odzwierciedlenie idei binarnej. Ciągła kreska mogła symbolizować 1, a przerywana 0. Dla Leibniza było to potężne potwierdzenie uniwersalności i elegancji kodu binarnego, który, jak wierzył, odzwierciedlał podstawowe zasady porządku wszechświata. Ta inspiracja z Dalekiego Wschodu z pewnością podsyciła jego własne prace nad systemem dwójkowym.

Gottfried Wilhelm Leibniz i jego przełomowe dzieło z 1703 roku

Rok 1703 był przełomowy dla rozwoju systemu binarnego, za sprawą publikacji Gottfrieda Wilhelma Leibniza. Jego praca, zatytułowana "Explication de l'Arithmétique Binaire", stanowiła kamień milowy, który na zawsze zmienił sposób, w jaki postrzegamy liczby i informacje. To właśnie w tym dziele Leibniz przedstawił światu kompletny i spójny system matematyczny oparty na zaledwie dwóch cyfrach.

"Explication de l'Arithmétique Binaire": co dokładnie opisał w niej Leibniz?

W swoim artykule "Explication de l'Arithmétique Binaire" Leibniz przedstawił szczegółowy opis systemu liczenia opartego wyłącznie na cyfrach 0 i 1. Wyjaśnił, jak można za pomocą tych dwóch symboli reprezentować dowolne liczby naturalne. Co więcej, opisał zasady wykonywania podstawowych operacji arytmetycznych, takich jak dodawanie, odejmowanie, mnożenie i dzielenie, w ramach tego dwójkowego systemu. Jego podejście było niezwykle systematyczne i formalne, co pozwoliło na jednoznaczne zrozumienie i zastosowanie przedstawionych koncepcji. To właśnie ta kompletność i precyzja sprawiły, że praca Leibniza jest uznawana za fundamentalną dla rozwoju informatyki.

Więcej niż matematyka: filozoficzne i teologiczne znaczenie systemu binarnego dla jego twórcy

Dla Gottfrieda Leibniza system binarny nie był jedynie abstrakcyjnym narzędziem matematycznym. Miał on dla niego głębokie znaczenie filozoficzne i teologiczne. Leibniz postrzegał system dwójkowy jako uniwersalny język stworzenia, odzwierciedlający prostotę i doskonałość boskiego porządku. Widział w nim analogię do aktu stworzenia świata przez Boga z niczego (0) powstało wszystko (1). Ta dualistyczna wizja świata, gdzie wszystko można sprowadzić do podstawowych, przeciwnych sobie elementów, była dla niego dowodem na istnienie harmonii i racjonalności w stworzeniu. Jego prace nad systemem binarnym były więc częścią szerszej filozoficznej refleksji nad naturą rzeczywistości.

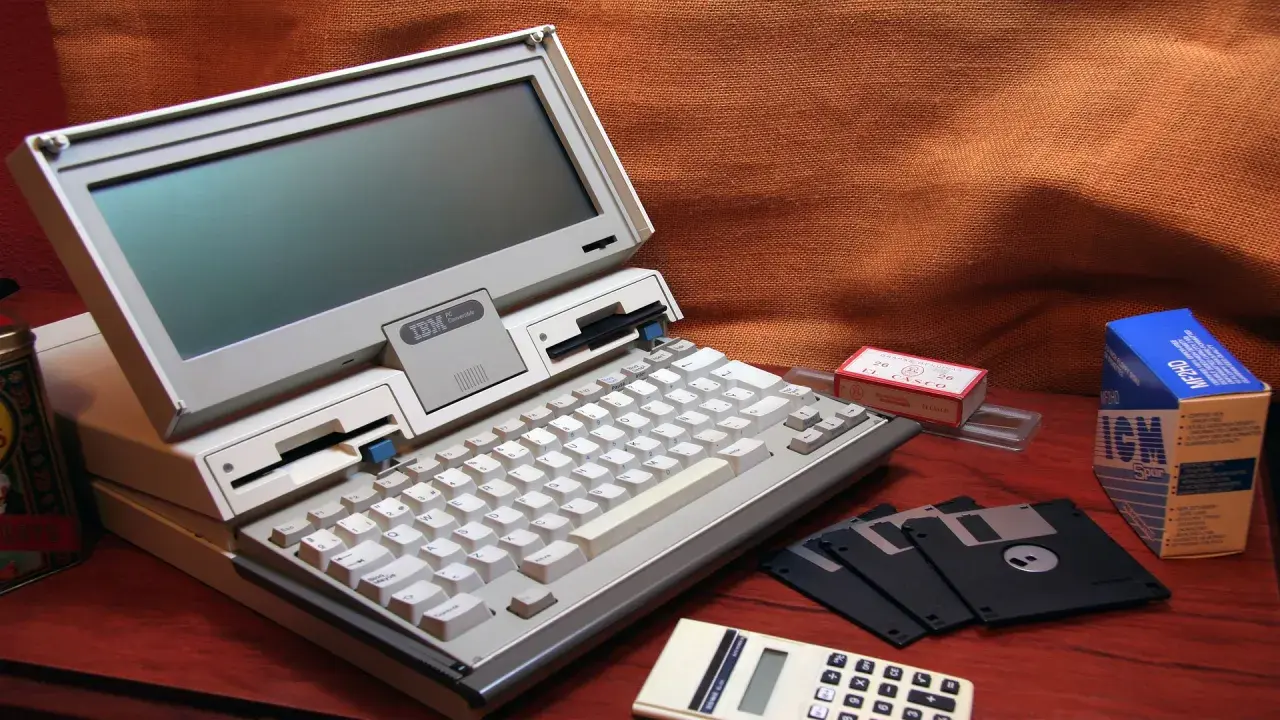

Od teorii do praktyki: jak system binarny stał się językiem komputerów?

Przez długi czas system binarny, opisany przez Leibniza, pozostawał głównie fascynującą koncepcją matematyczną, docenianą przez nielicznych. Jednak jego prawdziwy potencjał miał zostać odkryty dopiero wieki później, gdy ludzkość zaczęła tworzyć maszyny zdolne do przetwarzania informacji. Droga od teoretycznej elegancji do praktycznej rewolucji cyfrowej była długa i wymagała pracy wielu genialnych umysłów.

George Boole i logika, która zmieniła wszystko: czym jest algebra Boole'a?

Kluczowym krokiem w kierunku praktycznego zastosowania systemu binarnego było dzieło George'a Boole'a. W XIX wieku ten brytyjski matematyk stworzył system logiki formalnej, który dziś znamy jako algebrę Boole'a. Jego algebra operuje na dwóch wartościach: prawda i fałsz. Wartości te idealnie odpowiadały dwóm stanom systemu binarnego: 1 (prawda) i 0 (fałsz). Boole pokazał, że za pomocą prostych operacji logicznych, takich jak "i" (AND), "lub" (OR) czy "nie" (NOT), można opisywać i manipulować złożonymi zależnościami. To właśnie algebra Boole'a stała się matematycznym fundamentem dla projektowania systemów cyfrowych.

Claude Shannon: geniusz, który połączył bity z elektroniką

Prawdziwy przełom, który połączył abstrakcyjną logikę Boole'a z fizycznym światem elektroniki, dokonał Claude Shannon. W swojej przełomowej pracy magisterskiej z 1937 roku wykazał, że algebra Boole'a może być wykorzystana do projektowania i analizy obwodów elektrycznych, w szczególności tych opartych na przekaźnikach. Oznaczało to, że fizyczne przełączniki, które mogą być w stanie włączonym (1) lub wyłączonym (0), mogą realizować operacje logiczne. To odkrycie było fundamentalne dla rozwoju komputerów. Shannon pokazał, jak można budować proste układy logiczne, które stanowią cegiełki dla bardziej złożonych maszyn obliczeniowych. Jego praca położyła podwaliny pod całą erę cyfrową.

Dlaczego akurat system dwójkowy? Prostota, która napędza technologię

Wybór systemu binarnego jako podstawy technologii cyfrowej nie był przypadkowy. Mimo swojej prostoty, oferuje on szereg kluczowych zalet. Przede wszystkim, jest niezwykle łatwy do zaimplementowania w układach elektronicznych. Wystarczyły dwa odróżnialne stany na przykład obecność lub brak napięcia elektrycznego, wysoki lub niski poziom sygnału aby reprezentować bity 0 i 1. Ta prostota przekłada się na niezawodność; system dwójkowy jest znacznie mniej podatny na zakłócenia niż systemy o większej liczbie stanów. Ponadto, jego uniwersalność pozwala na reprezentowanie praktycznie każdej formy informacji, od liczb i tekstu po dźwięk i obraz.

System binarny dzisiaj: gdzie spotykasz zera i jedynki na co dzień?

Dziś system binarny jest tak wszechobecny, że często przestajemy zwracać na niego uwagę. Jest on niewidzialnym fundamentem niemal każdego aspektu naszego cyfrowego życia, wykraczając daleko poza tradycyjne komputery stacjonarne.

Nie tylko komputery: od smartfona po muzykę cyfrową

Każde urządzenie, które określamy mianem "cyfrowego", opiera swoje działanie na systemie binarnym. Wasz smartfon, który pozwala na komunikację, przeglądanie internetu i robienie zdjęć, przetwarza wszystkie te informacje jako ciągi zer i jedynek. Telewizory cyfrowe, odtwarzacze muzyki, aparaty fotograficzne, systemy nawigacji GPS, a nawet skomplikowane systemy bankowe i sieci komunikacyjne wszystkie one operują na danych w postaci binarnej. Niezależnie od tego, czy oglądacie film, słuchacie piosenki, czy wysyłacie e-mail, w głębi urządzenia te dane są ostatecznie reprezentowane jako sekwencje zer i jedynek.

Czy system binarny ma swoje wady? Ograniczenia i wyzwania

Mimo swojej dominacji, system binarny nie jest pozbawiony pewnych ograniczeń. Jednym z nich jest jego długa reprezentacja dużych liczb w porównaniu do systemu dziesiętnego. Na przykład, liczba 1000 w systemie dziesiętnym to w systemie binarnym 1111101000, co wymaga znacznie więcej cyfr do zapisania. Choć jest to kompensowane przez prostotę operacji i łatwość implementacji, w niektórych zastosowaniach może to oznaczać potrzebę większej przestrzeni do przechowywania danych. Ponadto, przetwarzanie bardzo dużych zbiorów danych w tradycyjny sposób może być czasochłonne, co stymuluje poszukiwanie nowych, bardziej wydajnych metod obliczeniowych.

Przyszłość kodu binarnego: czy czeka nas kolejna rewolucja?

Choć system binarny jest fundamentem dzisiejszej technologii, naukowcy i inżynierowie nieustannie poszukują nowych sposobów przetwarzania informacji. Przyszłość może przynieść rewolucje, które uzupełnią lub nawet zastąpią obecne paradygmaty, ale dziedzictwo klasycznych bitów pozostanie niezmienne.

Komputery kwantowe a bity: czym są kubity i czy zastąpią system dwójkowy?

Jednym z najbardziej ekscytujących kierunków rozwoju są komputery kwantowe. W przeciwieństwie do klasycznych komputerów, które operują na bitach (0 lub 1), komputery kwantowe wykorzystują kubity. Kubity, dzięki zjawiskom mechaniki kwantowej, takim jak superpozycja i splątanie, mogą reprezentować jednocześnie wartości 0, 1, a także ich kombinacje. Otwiera to drzwi do rozwiązywania problemów, które są obecnie poza zasięgiem najpotężniejszych superkomputerów. Czy technologia kwantowa całkowicie zastąpi system binarny? Prawdopodobnie nie. Bardziej prawdopodobne jest, że komputery kwantowe będą specjalistycznymi narzędziami do rozwiązywania konkretnych, niezwykle złożonych problemów, podczas gdy klasyczne komputery binarne nadal będą służyć do większości codziennych zastosowań.

Przeczytaj również: Jak przekształcić litery na kod binarny? Krok po kroku

Dziedzictwo Leibniza, Boole'a i Shannona: jak ich praca kształtuje naszą przyszłość?

Niezależnie od tego, jakie nowe paradygmaty obliczeniowe pojawią się w przyszłości, fundamentalne prace Gottfrieda Leibniza, George'a Boole'a i Claude'a Shannona pozostaną niezmiennie ważne. Leibniz nadał systemowi binarnemu matematyczną formę, Boole stworzył logikę, która pozwoliła na jego opis, a Shannon połączył te idee z praktyczną elektroniką, otwierając drogę do ery komputerów. Ich odkrycia nie tylko ukształtowały świat, w którym żyjemy, ale nadal stanowią podstawę dla rozwoju technologii i będą inspirować przyszłe pokolenia inżynierów i naukowców. Dziedzictwo tych trzech wizjonerów jest fundamentem naszej cyfrowej przyszłości.