Kluczowe etapy w historii sztucznej inteligencji

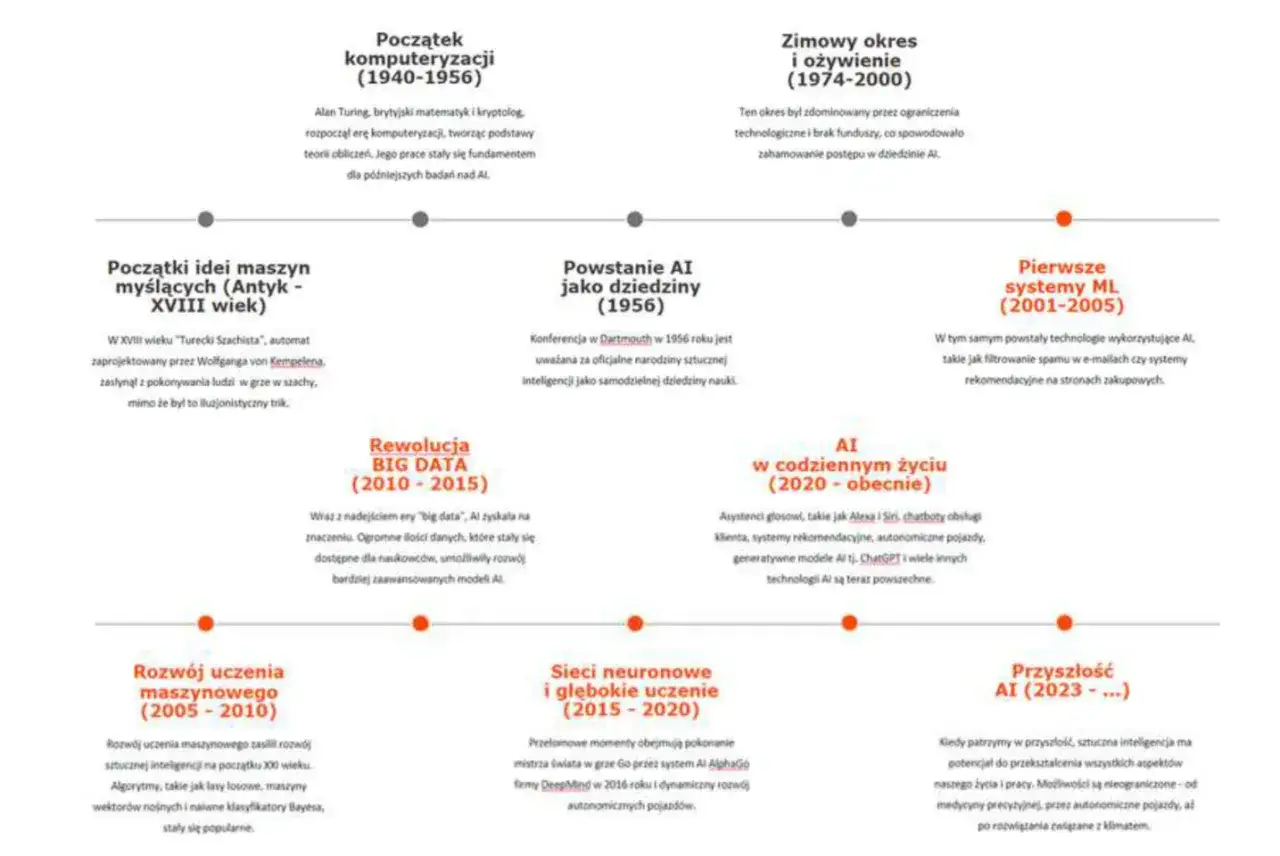

- Koncepcja AI ma korzenie w latach 40. i 50. XX wieku, z Alanem Turingiem i jego Testem Turinga jako kluczowymi postaciami.

- Oficjalny początek dziedziny to konferencja w Dartmouth w 1956 roku, gdzie John McCarthy ukuł termin "sztuczna inteligencja".

- Pierwsze programy, takie jak Logic Theorist i chatbot ELIZA, oraz język LISP, zapoczątkowały wczesne sukcesy.

- Historia AI obejmuje również "zimy AI" (lata 70. i 80.), czyli okresy stagnacji i cięć w finansowaniu badań.

- Renesans nastąpił dzięki rozwojowi uczenia maszynowego, głębokiego uczenia, wzrostowi mocy obliczeniowej i dostępności Big Data.

- Przełomowe osiągnięcia, takie jak zwycięstwa Deep Blue i AlphaGo nad ludzkimi mistrzami, pokazały rosnącą potęgę AI.

Dlaczego historia AI jest ważniejsza niż kiedykolwiek wcześniej?

W dzisiejszym świecie, gdzie sztuczna inteligencja przenika niemal każdy aspekt naszego życia, od rekomendacji filmów po diagnozy medyczne, zrozumienie jej historii staje się nie tyle ciekawostką, co koniecznością. Pomyślmy tylko ta sama technologia, która napędza algorytmy na giełdzie, zaczynała od teoretycznych rozważań o możliwościach maszyn. Od smartfona w kieszeni po algorytmy na giełdzie jak przeszłość AI kształtuje naszą teraźniejszość? Odpowiedź leży w zrozumieniu, że każda współczesna innowacja jest zbudowana na fundamentach wcześniejszych odkryć, sukcesów i porażek. Bez tej wiedzy, jesteśmy jak żeglarze bez mapy, dryfujący po oceanie technologii bez celu. Zrozumieć wczoraj, by przewidzieć jutro: czego uczy nas ewolucja sztucznej inteligencji? Historia AI to fascynująca opowieść o ludzkiej pomysłowości, ale także o ograniczeniach i potrzebie realistycznych oczekiwań. Pozwala nam dostrzec cykliczność rozwoju, momenty euforii przeplatane okresami zwątpienia, tak zwane "zimy AI". Poznanie tych lekcji jest kluczowe, abyśmy mogli świadomie kształtować przyszłość tej potężnej technologii, unikając powtarzania błędów i maksymalizując jej potencjał dla dobra ludzkości. To właśnie ta chronologiczna perspektywa pozwala nam dostrzec, jak daleko zaszliśmy i jak wiele jeszcze przed nami.Od mitów do maszyn: Skąd wzięła się idea sztucznej inteligencji?

Chociaż termin "sztuczna inteligencja" jest stosunkowo nowy, sama idea tworzenia istot myślących lub automatów zdolnych do naśladowania ludzkich działań sięga głęboko w historię ludzkości. Już w starożytnych mitach odnajdujemy opowieści o mechanicznych istotach, takich jak Talos, brązowy olbrzym strzegący Krety, czy legendy o golemach istotach z gliny ożywionych mocą magiczną. Te historie, choć fantastyczne, odzwierciedlają odwieczne ludzkie pragnienie zrozumienia i odtworzenia inteligencji, a nawet życia.

Filozoficzne podwaliny pod ideę maszyn myślących zaczęły się krystalizować znacznie później. Myśliciele tacy jak Gottfried Wilhelm Leibniz w XVII wieku marzyli o uniwersalnym języku logiki, który pozwoliłby na rozwiązywanie sporów w sposób czysto mechaniczny. Jego prace nad rachunkiem logicznym, choć nie w pełni zrealizowane, stanowiły ważny krok w kierunku formalizacji myślenia. Sto lat później, George Boole opracował algebrę logiki, która pokazała, jak można reprezentować operacje myślowe za pomocą symboli i reguł matematycznych. To właśnie te formalne systemy logiczne stały się kluczowym elementem, który pozwolił na późniejsze stworzenie algorytmów i maszyn zdolnych do przetwarzania informacji w sposób przypominający ludzkie rozumowanie.

Alan Turing i pytanie, które zmieniło wszystko: "Czy maszyny mogą myśleć?"

W połowie XX wieku, w obliczu rozwoju pierwszych komputerów, jedno pytanie zaczęło dominować w umysłach naukowców: czy maszyny mogą naprawdę myśleć? Odpowiedź na nie próbował dać brytyjski matematyk i kryptolog, Alan Turing. Jego przełomowy artykuł z 1950 roku, zatytułowany "Computing Machinery and Intelligence", nie tylko postawił to fundamentalne pytanie, ale także zaproponował metodę jego weryfikacji słynny Test Turinga.

Test Turinga to prosty, lecz genialny eksperyment myślowy. Polega on na tym, że człowiek-sędzia prowadzi rozmowę tekstową z dwoma nieznanymi mu rozmówcami jednym człowiekiem i jedną maszyną. Jeśli sędzia nie jest w stanie odróżnić maszyny od człowieka, można uznać, że maszyna zdała test i wykazuje zachowania inteligentne. Choć Test Turinga do dziś budzi dyskusje i nie jest powszechnie akceptowany jako ostateczne kryterium inteligencji, stanowi on kamień milowy w historii AI, wyznaczając kierunek dla badań nad możliwościami maszyn. Warto pamiętać, że geniusz Turinga nie ograniczał się do teorii; jego praca przy łamaniu niemieckich szyfrów, w tym słynnej Enigmy podczas II wojny światowej, była praktycznym dowodem na to, jak wizja inteligentnych maszyn może mieć realny, wręcz historyczny wpływ.

Lato 1956 w Dartmouth: Jak narodziła się nowa dziedzina nauki?

Choć idee dotyczące maszyn myślących krążyły w powietrzu od lat, oficjalny początek sztucznej inteligencji jako odrębnej dziedziny naukowej przypisuje się pewnemu letniemu spotkaniu w Stanach Zjednoczonych. Latem 1956 roku, na Dartmouth College, odbyła się konferencja, która na zawsze zmieniła oblicze informatyki i kognitywistyki. To właśnie tam John McCarthy, młody naukowiec zafascynowany możliwościami obliczeniowymi, po raz pierwszy użył terminu, który miał zdefiniować całą epokę: "sztuczna inteligencja" (artificial intelligence).

McCarthy, wraz z innymi wybitnymi umysłami tamtych czasów Marvinem Minskim, Allenem Newellem, Herbertem A. Simonem i Claudem Shannonem zebrał się, by zgłębić fundamentalne pytanie: czy każdy aspekt uczenia się lub innej cechy inteligencji można tak precyzyjnie opisać, że maszyna będzie mogła go symulować? Wszyscy uczestnicy konferencji podzielali głębokie przekonanie, że jest to możliwe. Ich celem było zbadanie możliwości stworzenia maszyn, które potrafiłyby rozumować, uczyć się, planować i rozwiązywać problemy w sposób podobny do ludzkiego. Konferencja w Dartmouth była nie tylko narodzinami nazwy, ale przede wszystkim zdefiniowaniem ambitnego programu badawczego, który inspirował kolejne pokolenia naukowców.

Pierwsze jaskółki sukcesu: Optymizm lat 60. i 70.

Po entuzjastycznym starcie, jakim była konferencja w Dartmouth, lata 60. i 70. XX wieku przyniosły pierwsze konkretne dowody na to, że idea sztucznej inteligencji nie jest tylko marzeniem. Naukowcy zaczęli tworzyć programy, które potrafiły wykonywać zadania uznawane dotąd za domenę ludzkiego intelektu. Jednym z takich pionierskich osiągnięć był Logic Theorist, stworzony w 1956 roku przez Allena Newella i Herberta Simona. Program ten był w stanie samodzielnie dowodzić twierdzeń matematycznych z Principia Mathematica Bertranda Russella i Alfreda Northa Whiteheada, co było spektakularnym sukcesem i dowodem na potencjał maszyn w dziedzinie logicznego rozumowania.

Kolejnym przełomem, który pokazał, jak maszyny mogą naśladować ludzką komunikację, była ELIZA. Stworzony w 1966 roku przez Josepha Weizenbauma, ELIZA była jednym z pierwszych chatbotów, który symulował rozmowę z psychoterapeutą, wykorzystując proste techniki przetwarzania języka naturalnego. Choć jej "inteligencja" była iluzoryczna, zaskoczyła wielu użytkowników swoją zdolnością do prowadzenia pozornej konwersacji. Równolegle, John McCarthy stworzył język programowania LISP (List Processing), który stał się fundamentalnym narzędziem w badaniach nad AI przez kolejne dekady, szczególnie w Stanach Zjednoczonych. Okres ten obfitował również w rozwój systemów ekspertowych, takich jak MYCIN, które miały naśladować wiedzę i proces decyzyjny ludzkich specjalistów w konkretnych dziedzinach, budząc nadzieję na przyszłość, w której komputery staną się cyfrowymi doradcami w każdej dziedzinie.

Gdy obietnice przerosły możliwości: Czym były "zimy sztucznej inteligencji"?

Historia rozwoju sztucznej inteligencji nie była jednak pasmem nieprzerwanych sukcesów. Okresy wielkiego optymizmu i obietnic często kończyły się rozczarowaniem, gdy okazywało się, że możliwości technologiczne nie nadążają za ambicjami badaczy. Tak narodziło się zjawisko znane jako "zimy sztucznej inteligencji" okresy spowolnienia w rozwoju, charakteryzujące się cięciami w finansowaniu badań i ogólnym spadkiem zainteresowania dziedziną.

Pierwsza "zima AI" nadeszła w latach 70. XX wieku. Po początkowych, obiecujących sukcesach, okazało się, że wiele problemów, które wydawały się łatwe do rozwiązania, w rzeczywistości wymagało znacznie większej mocy obliczeniowej i lepszych algorytmów, niż były dostępne. Rządy i instytucje finansujące badania zaczęły wycofywać środki, rozczarowane brakiem spektakularnych postępów. Podobny los spotkał dziedzinę pod koniec lat 80. i na początku lat 90., podczas drugiej "zimy AI". Tym razem przyczyniło się do tego załamanie rynku systemów ekspertowych, które, mimo początkowego entuzjazmu, okazały się zbyt drogie w utrzymaniu i zbyt ograniczone w zastosowaniu. Te trudne okresy nauczyły jednak badaczy cennej lekcji: konieczności realistycznego podchodzenia do możliwości AI i skupienia się na praktycznych, osiągalnych celach. Jak podaje wifi4eu.pl, "zimy AI" były bolesnym, ale ważnym etapem w dojrzewaniu tej dziedziny.

Wielki powrót: Jak uczenie maszynowe i sieci neuronowe zrewolucjonizowały AI?

Po okresach stagnacji, sztuczna inteligencja doświadczyła spektakularnego renesansu, który rozpoczął się na dobre w latach 90. i nabrał tempa na początku XXI wieku. Kluczem do tego odrodzenia okazało się przesunięcie paradygmatu badawczego od prób ręcznego programowania maszyn do wykonywania konkretnych zadań, do podejścia opartego na uczeniu maszynowym (machine learning). Zamiast dyktować komputerom każdy krok, naukowcy zaczęli tworzyć algorytmy, które potrafiły uczyć się na podstawie danych.Rewolucję tę umożliwiły dwa kluczowe czynniki. Po pierwsze, dramatyczny wzrost mocy obliczeniowej komputerów, który pozwolił na przetwarzanie ogromnych ilości informacji w rozsądnym czasie. Po drugie, eksplozja dostępności danych zjawisko znane jako Big Data. Ogromne zbiory informacji, od tekstów w internecie po obrazy i dźwięki, stały się paliwem dla algorytmów uczenia maszynowego. Szczególnie przełomowe okazało się głębokie uczenie (deep learning), rozwijane m.in. przez Geoffreya Hintona i jego współpracowników. Wykorzystując złożone, wielowarstwowe sieci neuronowe, inspirowane budową ludzkiego mózgu, algorytmy te zaczęły osiągać wyniki wcześniej nieosiągalne w takich dziedzinach jak rozpoznawanie obrazów, mowy czy tłumaczenie maszynowe. To właśnie te postępy otworzyły drzwi do współczesnej ery AI.

Symboliczne zwycięstwa maszyny nad człowiekiem: Kamienie milowe nowej ery AI

Wraz z rozwojem uczenia maszynowego i głębokiego uczenia, sztuczna inteligencja zaczęła osiągać wyniki, które na długo przedtem wydawały się domeną science fiction. Dwa wydarzenia szczególnie mocno wybrzmiały w świadomości publicznej, pokazując potęgę maszyn w dziedzinach wymagających strategicznego myślenia i złożonej analizy. Pierwszym z nich było zwycięstwo komputera Deep Blue firmy IBM nad ówczesnym mistrzem świata w szachach, Garri Kasparowem, w 1997 roku. Był to symboliczny moment, pokazujący, że maszyna potrafi pokonać najlepszego ludzkiego gracza w grze o tak ogromnej liczbie możliwych ruchów i strategii.

Jednakże, prawdziwym testem inteligencji okazała się gra Go, znana ze swojej niezwykłej złożoności i intuicyjnego charakteru, która przez lata uchodziła za niemożliwą do opanowania przez AI. Przełom nastąpił w 2016 roku, gdy program AlphaGo stworzony przez DeepMind (należące do Google) pokonał mistrza świata Lee Sedola. Wygrana w Go była znacznie większym wyzwaniem niż szachy, wymagającym nie tylko obliczeń, ale także czegoś, co przypominało ludzką intuicję. Te symboliczne zwycięstwa nie tylko zademonstrowały rosnącą potęgę AI, ale także zainspirowały dalsze badania i inwestycje w tę dziedzinę, otwierając nowy rozdział w jej historii.

Sztuczna inteligencja dzisiaj: Od modeli językowych do rewolucji generatywnej

Obecnie znajdujemy się w samym sercu kolejnej rewolucji AI, napędzanej przez rozwój dużych modeli językowych (LLM), takich jak seria GPT. Te zaawansowane systemy, trenowane na niewyobrażalnych ilościach danych tekstowych i kodowych, potrafią generować spójne i kreatywne teksty, odpowiadać na złożone pytania, tłumaczyć języki, a nawet pisać kod programistyczny. Zjawisko to określamy mianem generatywnej AI, która fundamentalnie zmienia sposób, w jaki tworzymy treści, analizujemy informacje i wchodzimy w interakcje z technologią.

Przyszłość AI rysuje się jako fascynująca podróż w kierunku stworzenia Sztucznej Inteligencji Ogólnej (AGI) hipotetycznej maszyny, która dorównywałaby ludzkiej inteligencji we wszystkich jej aspektach. Choć droga do AGI jest wciąż pełna wyzwań, potencjalne korzyści od rozwiązania globalnych problemów po znaczące przyspieszenie postępu naukowego są ogromne. Zrozumienie historii AI, od jej teoretycznych początków po dzisiejsze przełomy, daje nam perspektywę niezbędną do świadomego kształtowania tej potężnej siły, która już teraz redefiniuje nasz świat.